Review – NVIDIA GeForce RTX 2080 FE

Fala pessoal, beleza?

Nesse review irei analisar a GeForce RTX 2080, que trata-se de uma VGA High-End pertencente a nova série RTX da nVidia e que também marca a estreia dos GPUs da arquitetura Turing cujos destaques incluem o suporte e capacidade de usar Ray Tracing em tempo real, um novo tipo de AA usando Deep Learning, Mesh shaders e execução simultânea de instruções INT32 e FP32, conforme discuti nesse artigo sobre o 3DMark Port Royal.

O modelo que tenho em mãos é uma Founders Edition, que no caso da série RTX, além de placa de referência, agora também foi promovida a modelo de construção mais refinada, com overclock de fabrica sendo vendida diretamente pela própria nVidia.

A caixa destaca bem a série e o modelo da placa, não trazendo informações sobre features ou extras como é usual vermos nas embalagens e provavelmente isso foi feito assim por conta dessa placa em especifico ser vendida apenas na loja online da nVidia onde essas informações são mostradas de forma clara. No mais, foi adotado um grafismo cinza chumbo e o design agrada por ser bastante limpo, sem firulas. 🙂

A placa vem acomodada dentro da caixa de forma semelhante a da 1080Ti Lightning e o bundle, composto por um cabo adaptador HDMI->DVI e um guia de instruções, vem dentro de uma caixinha, conforme a foto abaixo.

Por fim, a VGA em si é mais pesada que o esperado para uma VGA dual-slot e isso se deve ao fato de até mesmo a “carcaça” do cooler ser em metal ao invés de plástico como é o usual. Definitivamente a qualidade do acabamento dessa placa impressiona e ela realmente passa a impressão de ser um produto premium! Ao contrário da “Founders Edition” da geração anterior que usavam um blower para forçar o ar entre as aletas do dissipador, nas RTX, a nVidia optou por utilizar dois fans de 90mm, configuração que tende a priorizar menor ruído de operação com saida da maior parte do ar quente pelas laterais da placa (fluxo radial), portanto, é importante que o fluxo de ar no gabinete esteja em dia.

A RTX2080 FE possui 27cm de comprimento, o que não deve ser problema para a maioria dos gabinetes modernos, mesmo considerando os modelos mais modestos. O TDP dessa placa é de 225W.

No espelho traseiro, a RTX2080 FE oferece 3x Displayport, 1x HDMI e uma porta VirtualLink, que usa o mesmo conector USB-C só que tem como finalidade a conexão com novos dispositivos VR.

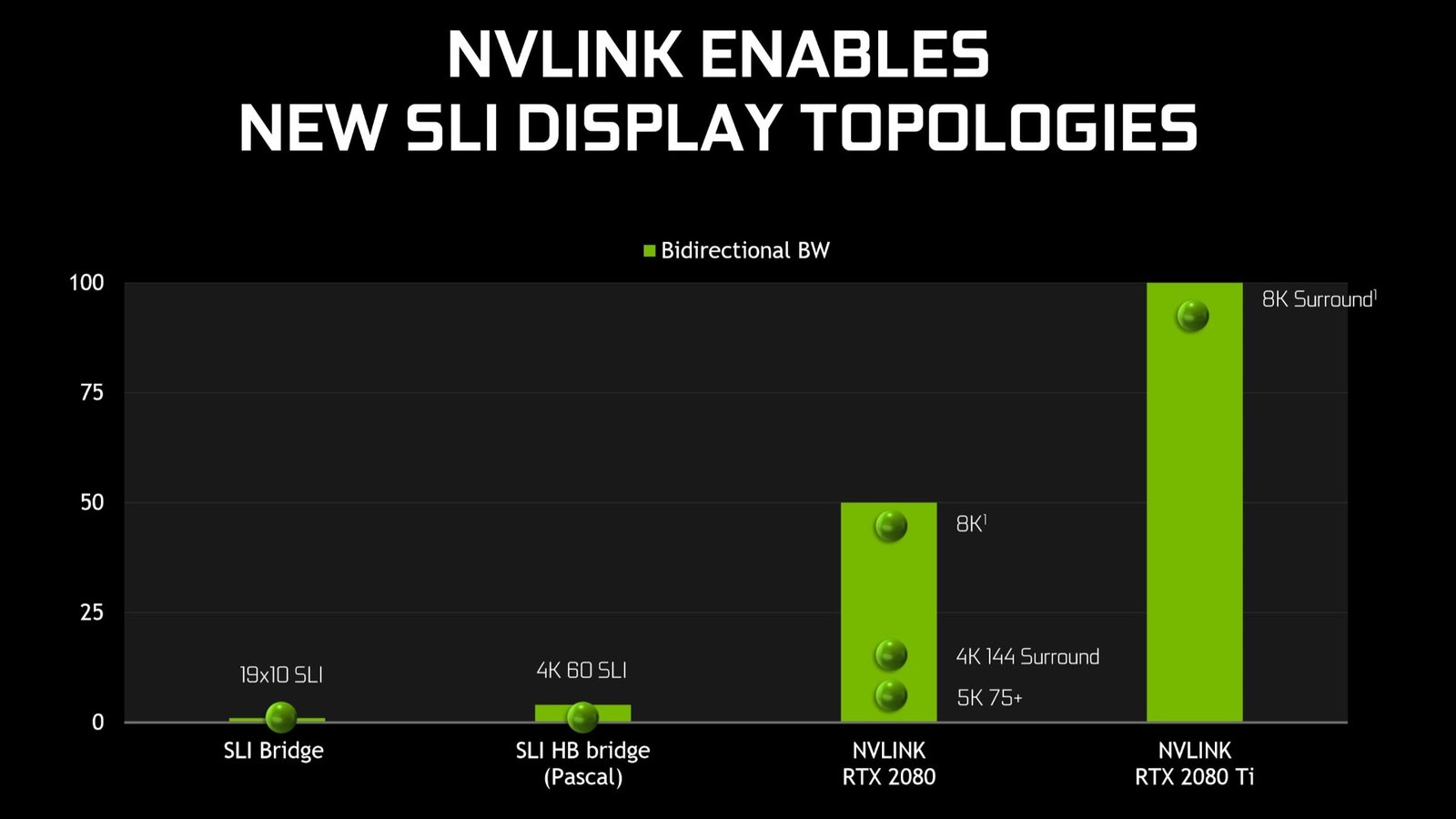

O TU104, que é o GPU usado na RTX2080 também suporta o NVLink, ainda que oferecendo metade da banda (~50GB/s bidirecional) do seu irmão maior, o TU102. Esse protocolo usa um conector que é visivelmente diferente daquele usado pelas “clássicas” pontes SLI que foram usadas até a geração Pascal, portanto, caso pretenda fazer SLI (um adendo: esse só é suportado pelas RTX2080Ti e 2080 e no máximo usando duas placas) é necessário adquirir uma ponte NVLink que custa cerca de $90 na loja da eVGA.

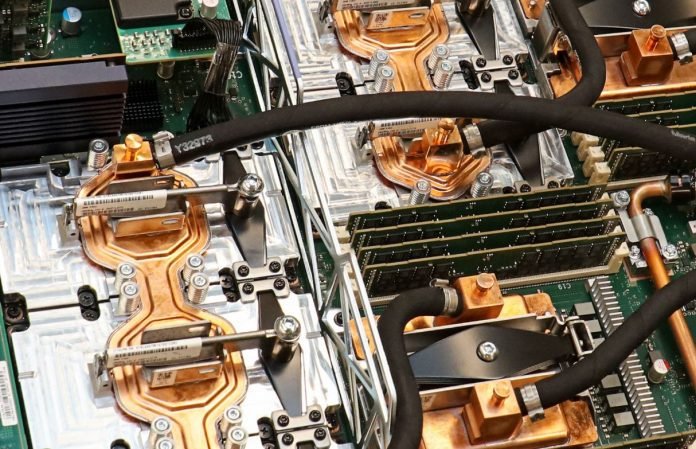

Apenas fazendo uma breve explanação, o NVLink é um protocolo de interconexão que permite a comunicação direta entre GPUs e até mesmo com CPUs (por exemplo: IBM Power9) que tenham um link desses integrado no die, o que permite diminuir o overhead no PCI-E, oferecendo menor latência e maior banda que este. No caso da implementação usada para HPC com a V100, o NVLink permite que esses GPUs trabalhem com memória unificada, ou em outras palavras, como se fossem só um “GPUzão” gigante.

Fonte: https://www.servethehome.com/us-doe-announces-summit-with-ibm-power-and-nvidia-tesla/

Já em um caso mais “mundano” como o SLI, o NVLink é usado para a comunicação dos GPUs, porém, a funcionalidade do SLI continua inalterada usando técnicas como AFR no seu funcionamento, ou seja, os GPUs não trabalham como se fossem apenas um GPU maior e sim que o SLI estará “rodando” em cima do NVLink se aproveitando da maior banda disponível e menor latência, permitindo assim o uso de resoluções maiores, configurações surround e melhorando o desempenho de forma geral, conforme o slide abaixo.

A RTX2080 FE usa dois conectores de força, sendo um de 8 pinos e outro de 6 pinos, o que não é um problema mesmo para fontes de potência mais modesta (ali pelos 450W) porém de boa qualidade.

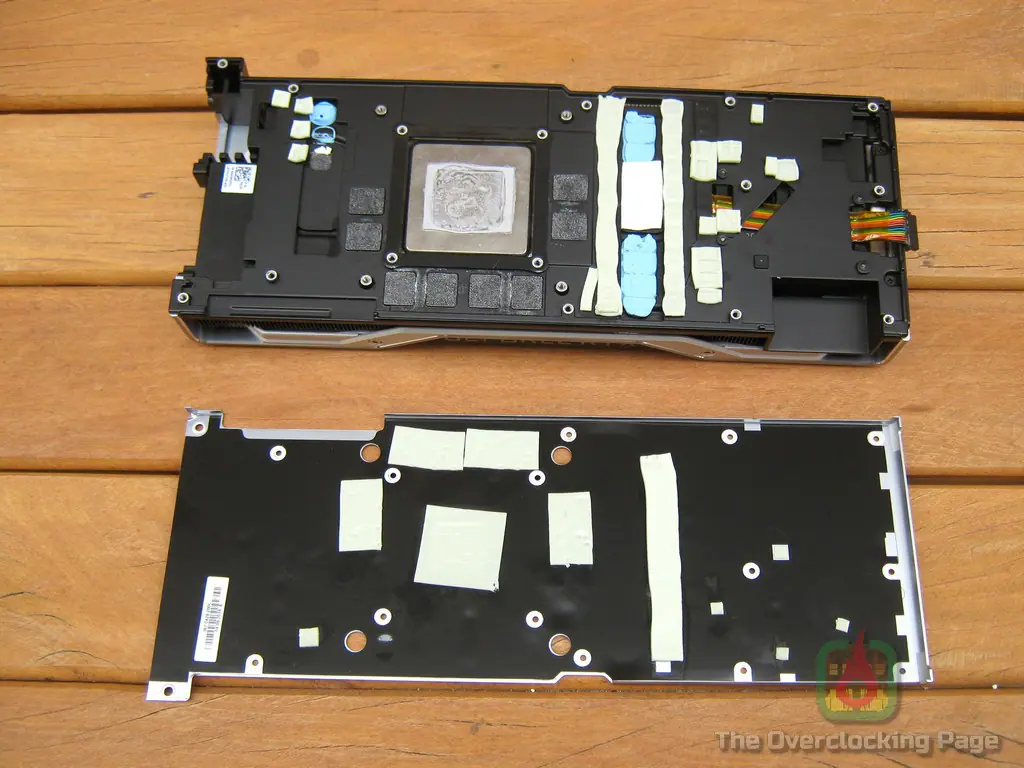

Antes de prosseguir com a biópsia da VGA devo fazer um pequeno alerta para quem pretende abrir essa placa: Esteja com um bom kit de ferramentas em mãos pois por alguma razão, a nVidia resolveu empregar diversos tipos diferentes de parafusos nessa placa, o que inclui alguns sextavados, allen e philips, sendo isso algo que dificulta na hora de abrir a VGA para fazer uma limpeza (manutenção), trocar a pasta térmica do GPU ou mesmo instalar um waterblock.

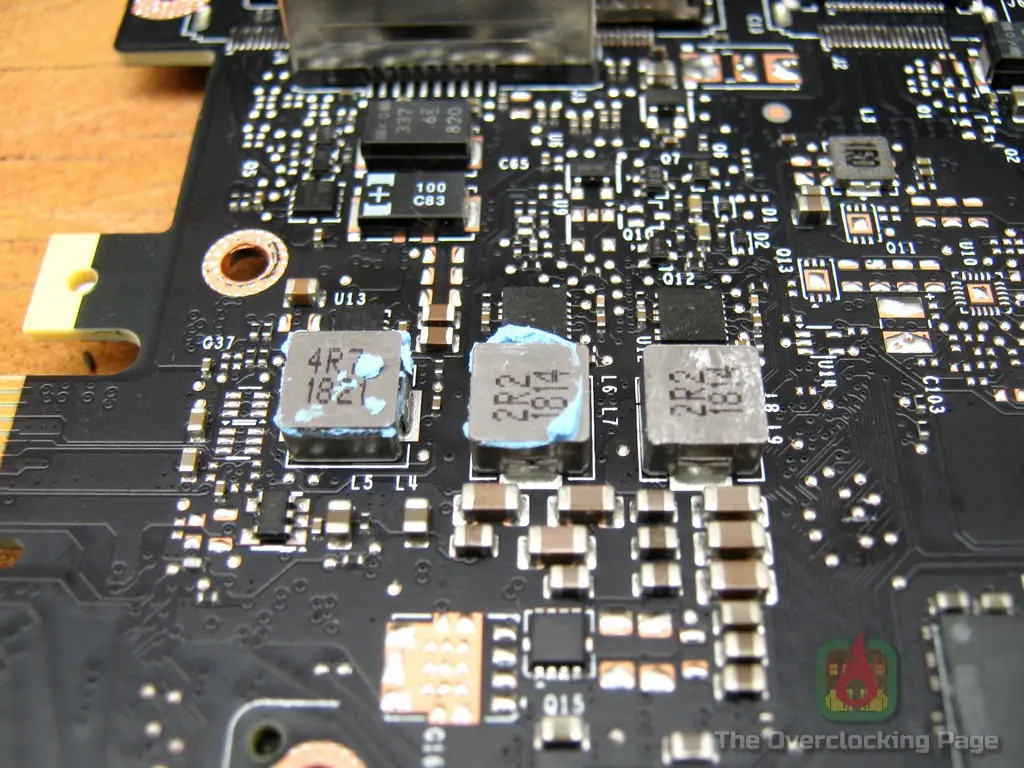

Uma coisa que me chamou a atenção é que não houve economia de thermalpads, sendo que até mesmo componentes onde não existe a necessidade de dissipador (exemplos: indutores e controlador PWM) fazem contato com o backplate/dissipador.

Em relação ao dissipador utilizado, a nVidia optou por um design usando uma “Vapor Chamber” na base de um dissipador grande refrigerado pelos dois supracitados fans de 90mm. Para quem desconhece o princípio de funcionamento da “Vapor Chamber”, basicamente funciona da mesma forma que um heatpipe só que com o fluído dentro de uma câmara ao invés de um tubo. Esse link trás mais detalhes e ilustra bem como esse sistema de refrigeração funciona.

Apesar desse cuidado ser algo positivo, devo destacar que alguns desses thermalpads, como os usados nas memórias e nos indutores, não são de forma alguma reutilizáveis mesmo sendo cuidadoso na hora de desmontar a placa, portanto, se a ideia for montar o cooler original novamente, tenha em mãos thermalpads novos e de espessura adequada para substituir os originais.

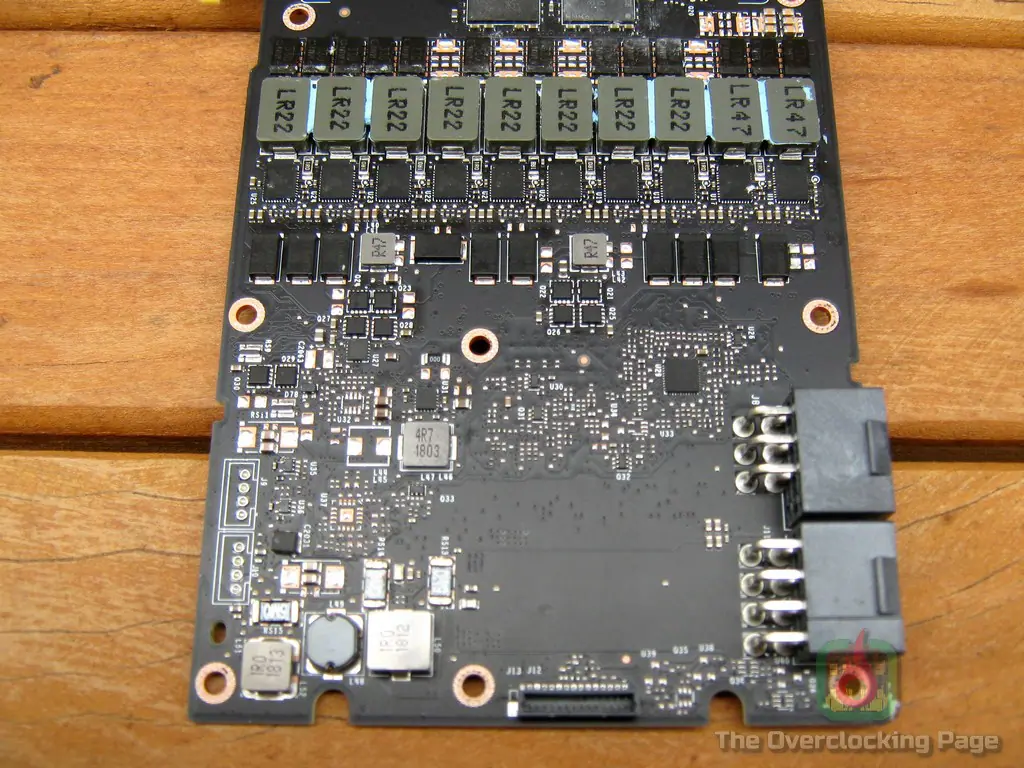

Finalmente chegamos ao pcb da placa, o qual tem mais ou menos o mesmo comprimento do conjunto de refrigeração e onde podemos ver o GPU TU104, os oito chips de memória GDDR6, o VRM de 8+2 fases, os shunts usados para medição do consumo da placa, os conectores de força e os demais componentes.

O variante do GPU usado na RTX 2080 FE é o TU104-400A-A1, fabricado na TSMC usando o processo 12FFN, que trata-se de uma otimização do processo 16FF usada exclusivamente pela nVidia. O die do TU104/TU140A tem massivos 545mm² de área, algo maior que o GP102 (471mm²) que equipa as 1080Ti e também 13.6bi de transistores. Como acabei de dizer, existem duas variantes do TU104, uma com o “A” e a outra sem (“non-A”) e a diferença entre elas é que o “A” tende a ser melhor binado e na média atinge clocks mais altos que o “non-A”, portanto, esses GPUs melhores acabam sendo empregados nos modelos mais rebuscados ou voltados ao uso em overclock extremo.

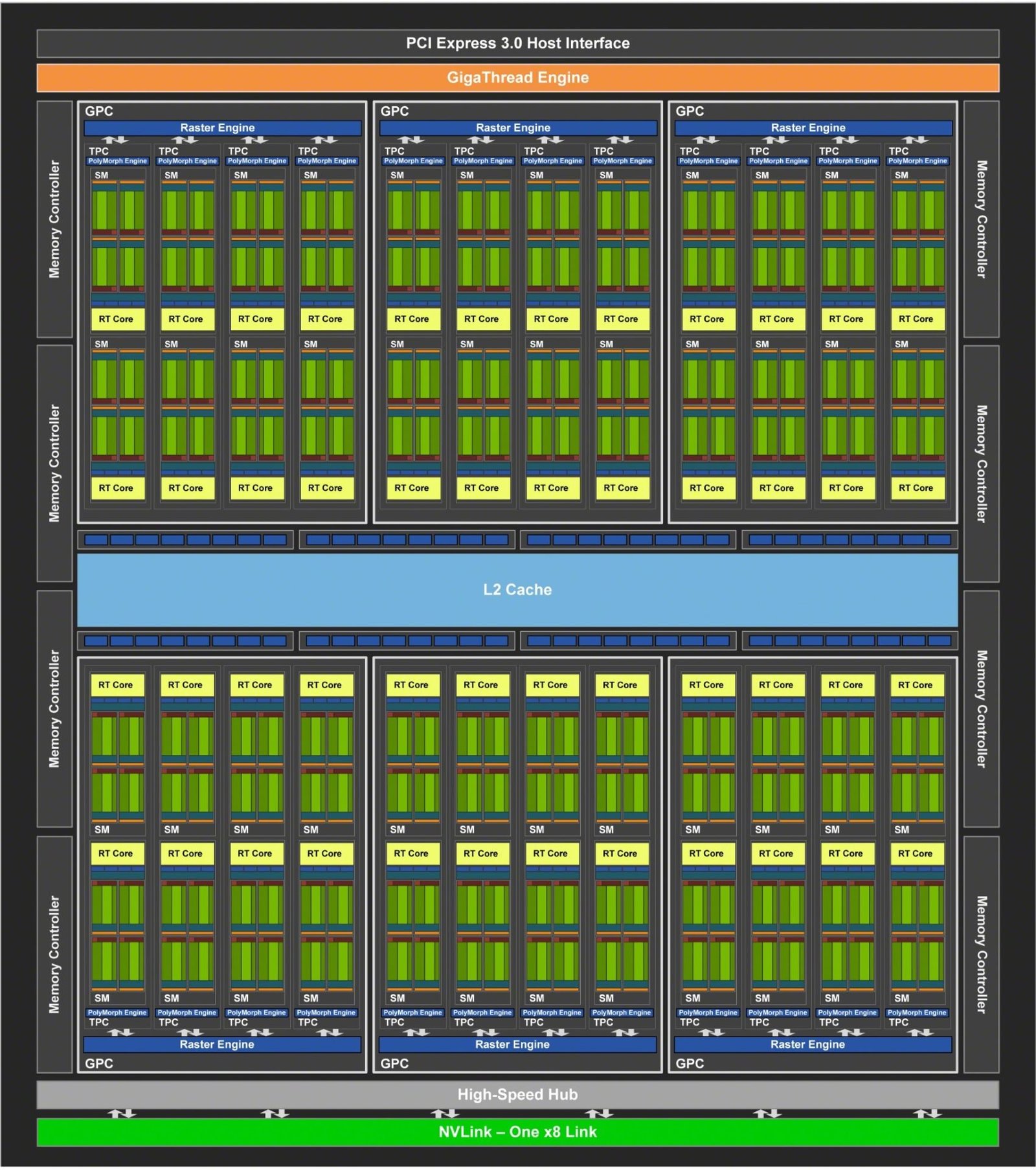

Em termos funcionais, o TU104-400 apresenta 46 SMs (2944 Cuda Cores), 368 Tensor Cores, 46 RT Cores, 184 TMUs, 64 ROPs e barramento de memória de 256-bits sendo que o TU104 “Full” (código: TU104-875-A1) atualmente é utilizada somente na Quadro RTX 5000. Apenas como curiosidade, de todas GeForce RTX apresentadas até o presente momento, apenas a RTX 2070 (TU106) utiliza o GPU com todas partes funcionais ativadas.

Para os interessados em mais detalhes sobre esse hardware, em como funcionam esses Tensor Cores ou RT Cores em um contexto mais “civil”, recomendo a leitura do artigo sobre o 3DMark Port Royal. 🙂

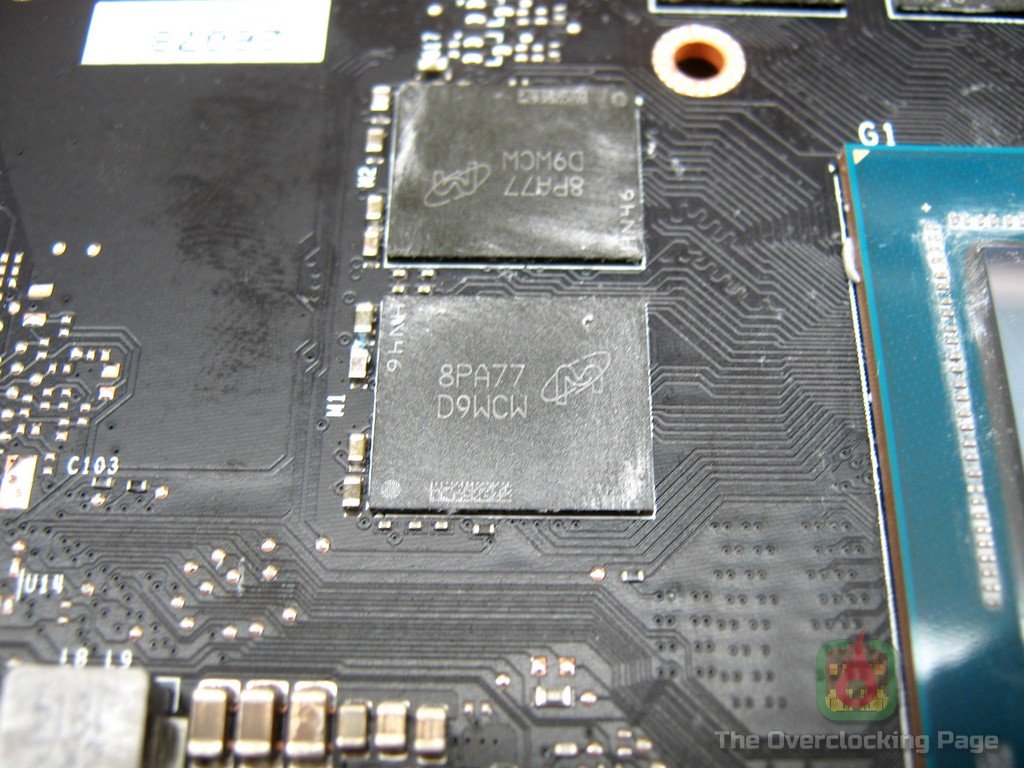

Os chips de memória GDDR6 são os Micron D9WCWs e após uma rápida busca, cheguei no código Micron MT61K256M32JE-14:A, que diz que essas memórias são de 14Gbps, basicamente as GDDR6 de especificação mais alta disponível e que excetuando-se o fabricante que pode mudar (a Samsung também fabrica memórias GDDR6), são usadas em todas GeForce RTX até o momento.

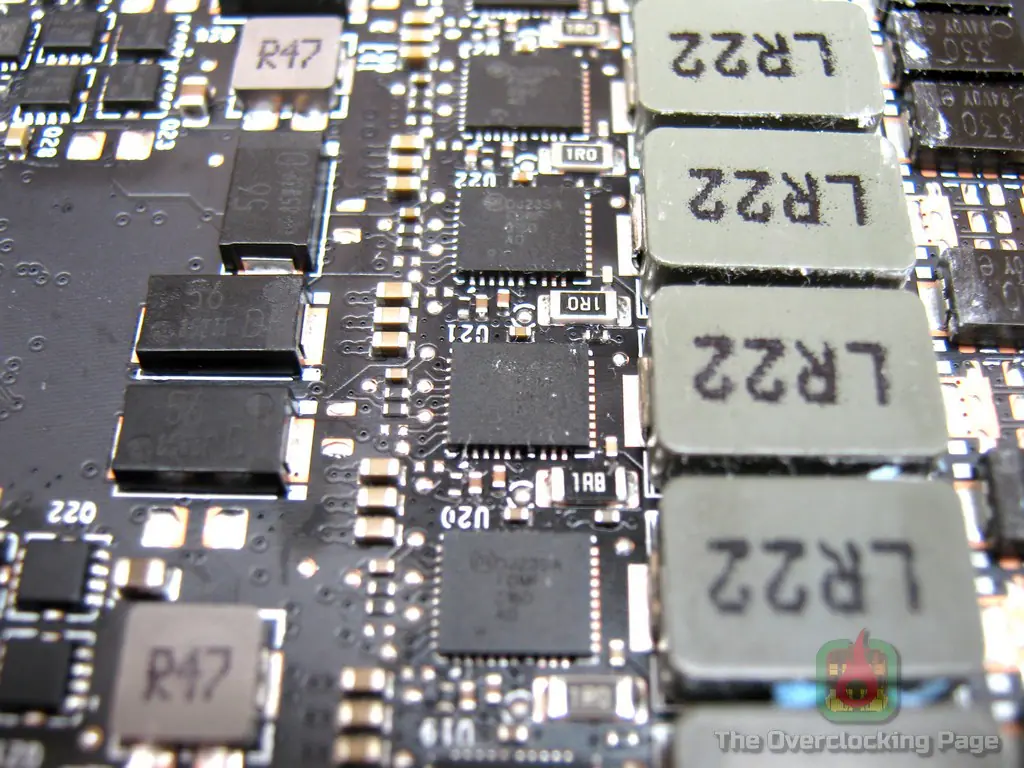

E enfim chegou a hora dos VRMs! Nas fotos abaixo é possível ver o VRM do GPU/VRAM, onde as oito fases relativas ao GPU usam indutores de 0.22uH (R22) e nas fases relativas as memórias foram usados dois indutores de 0.47uH (R47). Também é possível ver os três shunts que são utilizados para medir o consumo da placa, sendo um para cada conector de força e outro para o slot PCI-E e por fim, as três fases para tensões auxiliares como a alimentação da porta USB-C, sinais de vídeo, PLL e afins.

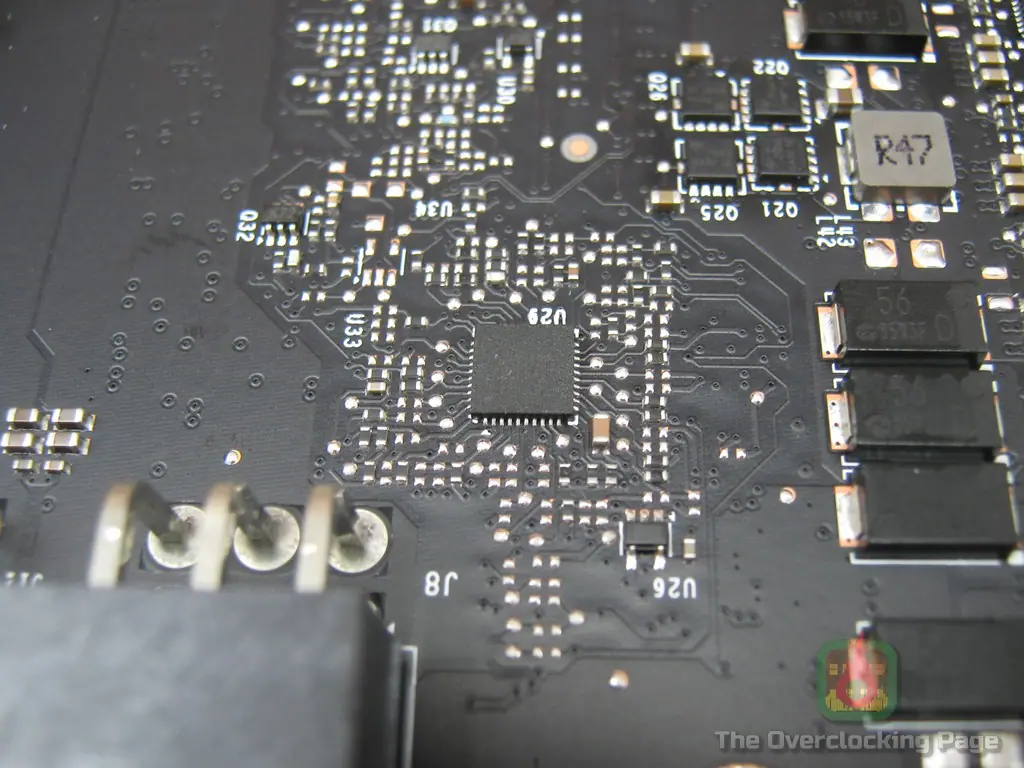

Ainda sobre os VRMs, como disse anteriormente, a nVidia optou por um design usando 8+2 fases para esse PCB de referência onde foram usados dois controladores PWM UP9512P, um deles operando com oito fases para o GPU e outro com duas fases para as memórias, o que significa que o uso de dobradores de fase para manter o acionamento independente das fases não foi necessário nem mesmo para o GPU, alias, é interessante mencionar que nenhum modelo de RTX2080/2080Ti utiliza CIs dobradores de fase, mesmo naqueles modelos que dizem ter 16 fases e isso provavelmente é assim por conta das especificações da nVidia para respostas de transientes nesses GPUs, que devem ser extremamente “apertadas” e impossíveis de se obter usando doublers.

No estágio de alimentação, foi usado o FDMF3160, que é um CI Powerstage (aqueles que integram mosfets low-side, high-side, driver, diodo schottky em um único encapsulamento) fabricado pela OnSemi e capaz de fornecer até 55A na saída. Definitivamente isso é algo excelente e definitivamente deve ser suficiente até mesmo para uso em overclock extremo, bastando nesse caso apenas fazer o vmod para ter ajuste de tensão acima dos 1.06V.

No estágio de filtragem, a nVidia optou por utilizar capacitores de tântalo em toda a placa, o que naturalmente inclui os capacitores de 330uF utilizados no filtro LC de saída dos VRMs e os de 56uF usados no filtro de entrada. Apesar desses capacitores normalmente serem um pouco mais caros que os de polímero de alumínio, eles tem a vantagem de serem bastante compactos, especialmente no eixo Z, o que simplifica o design do sistema de refrigeração e do ponto de vista elétrico, eles normalmente apresentam menor ESR/ESL, algo que é desejável nessa aplicação. Caso tenham interesse em buscar mais detalhes sobre esse ultimo ponto, nesse artigo abordei um pouco mais sobre o assunto. 🙂

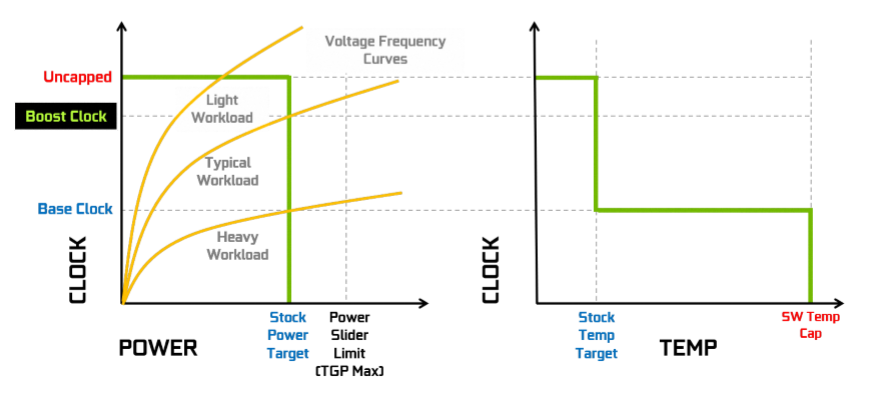

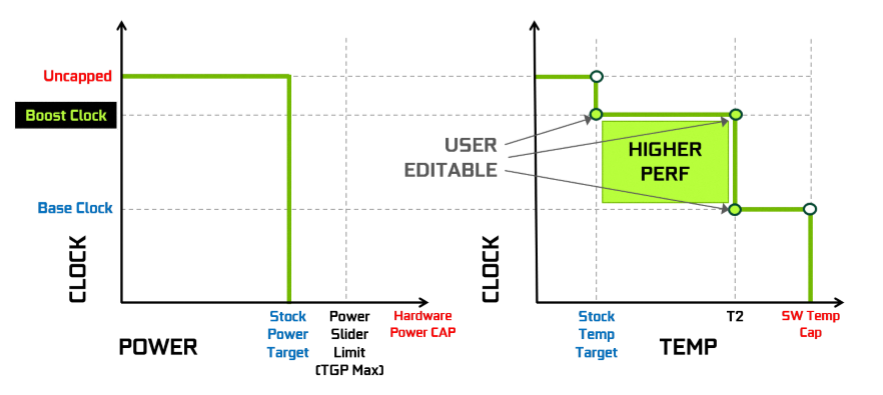

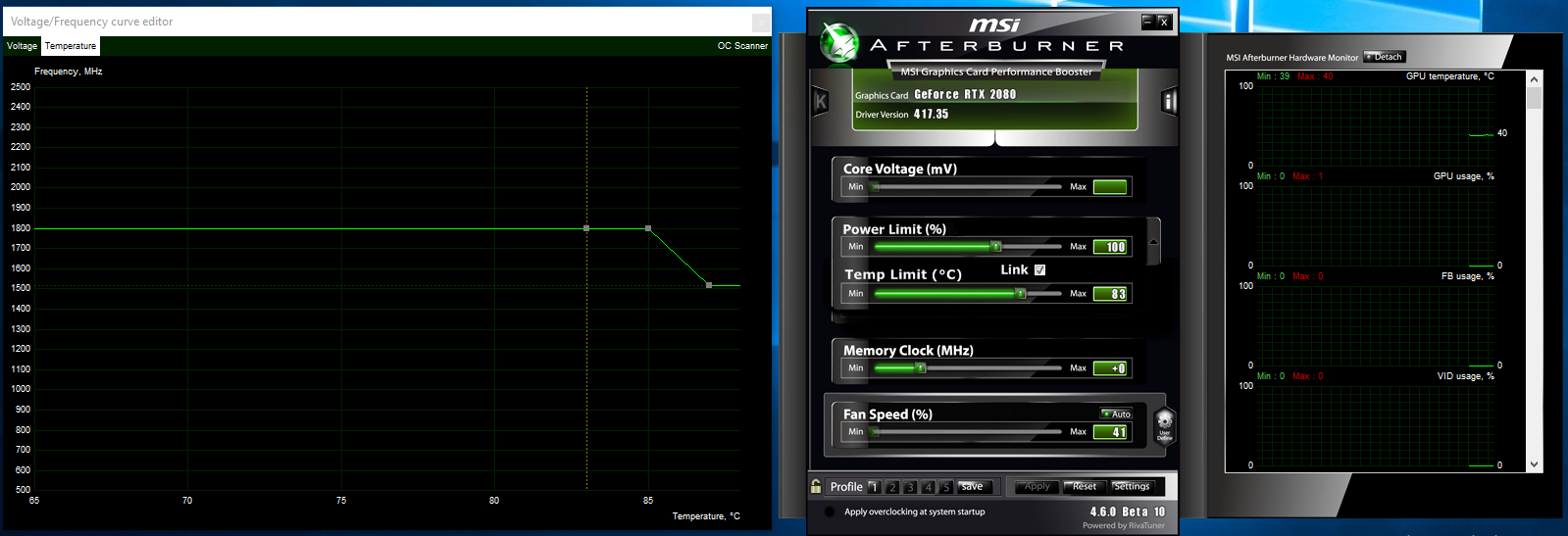

Ainda em relação ao GPU Boost, nas placas Turing o mesmo sofreu um “upgrade” e agora está em sua quarta interação. Em relação a versão 3.0, foi adicionada a possibilidade de configurar a curva de clock em função da temperatura, algo que pode ser especialmente útil para se tirar um pouco mais de desempenho do GPU em situações onde existem limitações na refrigeração da VGA (por exemplo: um gabinete com fluxo de ar reduzido). Em casos onde não existe nenhuma limitação do tipo, como é o caso nesse review, o melhor ajuste consiste simplesmente em deslocar a curva inteira para a direita, formando um retângulo ali no gráfico. No demais, o GPU Boost 4.0 continua funcionando da mesma forma do seu antecessor e permitindo os mesmos ajustes com base no offset ou da curva F/V. 🙂

Para acessar a configuração dessas curvas no Afterburner, como no screenshot abaixo, basta usar o atalho CTRL+F e dai ajustar os pontos conforme a necessidade e navegar entre as diferentes curvas usando as duas abas no topo do janela. Para facilitar a otimização de todos os pontos dessa curva, outros softwares (ex: EVGA Precision X1) trazem uma função “Scanner” que determinam offset ideal para a curva automaticamente poupando assim algum tempo no usuário na hora de otimizar ainda mais o funcionamento da GPU.

É importante salientar que fatores ambientais (ex: temperatura) e físicos (ex: tdp) desde sempre foram levados em consideração pelo algoritmo do GPU Boost, entretanto era muito mais simples de se “driblar” os mecanismos responsáveis pela leitura dos mesmos usando biosmod ou hardmod para forçar a placa a rodar sempre no clock máximo. Assim como nas GPUs Pascal, a abordagem ideal para se tirar o máximo de performance dos GPUs Turing é um pouco diferente devido a como o algoritmo do GPU Boost 3/4 trabalha a curva F/V em relação a temperatura do GPU, isso implica que mesmo sem alterar quaisquer parâmetros relacionados a clock de GPU/RAM, se de alguma forma você conseguir aumentar o Power Target e manter o GPU abaixo de um certo patamar de temperatura (digamos que, 50ºC), automaticamente a placa vai manter o clock do GPU no ponto máximo por mais tempo, o que trás ganhos óbvios de performance como veremos adiante. ?

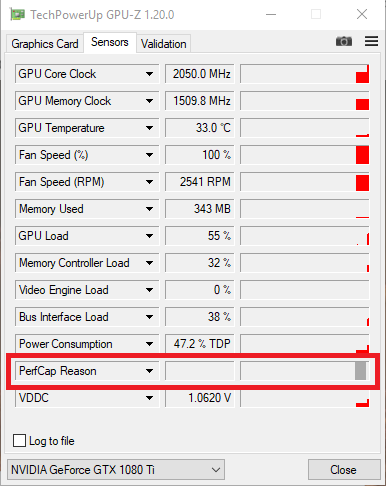

Isso é muito legal, mas como saber se a VGA está esbarrando nesses limites? Bom, existe um parâmetro chamado “PerfCap Reason” que pode ser monitorado pelo GPU-Z e ele indica qual a variável que está limitando a performance do GPU. No caso existem cinco variáveis e é possível esbarrar em mais de uma delas ao mesmo tempo e como mostrarei adiante, eliminar as causas do “PerfCap” podem ser muito benéficas para a performance da placa. ?

vRel = Reliability. Indicating performance is limited by voltage reliability.

VOp = Operating. Indicating performance is limited by max operating voltage (Hardware Limit).

Pwr = Power. Indicating performance is limited by total power limit.

Thrm = Thermal. Indicating performance is limited by temperature limit.

Util = Utilization. Indicating performance is limited by GPU utilization.

Configurações utilizadas:

CPU: AMD Ryzen 5 2600X e Ryzen 7 2700X (Obrigado AMD!)

MOBO: ASUS ROG Crosshair VII HERO

RAM: 2x8GB G.Skill Flare X 3200 CL14 (Samsung B-Die)

VGA: NVIDIA GeForce RTX 2080 (obrigado NVIDIA – agradecimentos especiais ao Alexandre Ziebert pelo suporte!)

STORAGE: SSD HyperX 3K 120GB

PSU: Antec Quattro 1200W

SO: Windows 7 x64 SP1 (Forceware 416.34), Windows 10 x64 1809

EQUIPAMENTOS EXTRAS: Medidor de consumo (Wattímetro, amperímetro) de tomada, basicamente um Kill-a-Watt genérico.

Objetivo dos testes:

Avaliar a performance da GTX2080 FE do ponto de vista de um overclocker, ou seja, usando benchmarks que são utilizados em cenário competitivo (HWBOT), verificar a performance da placa usando diferentes soluções térmicas (padrão de fabrica e water cooler) e por fim, verificar se a solução de refrigeração de fabrica cumpre o seu papel. Explicações acerca da metodologia adotada ou de como os testes foram conduzidos estão contidas nos textos que acompanham os resultados a seguir. 😉

Resultados:

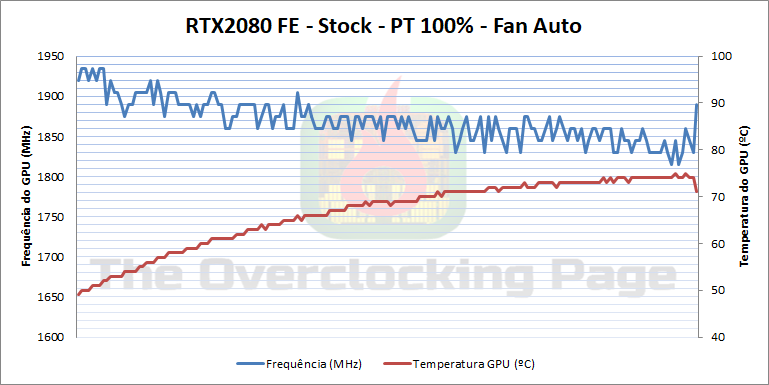

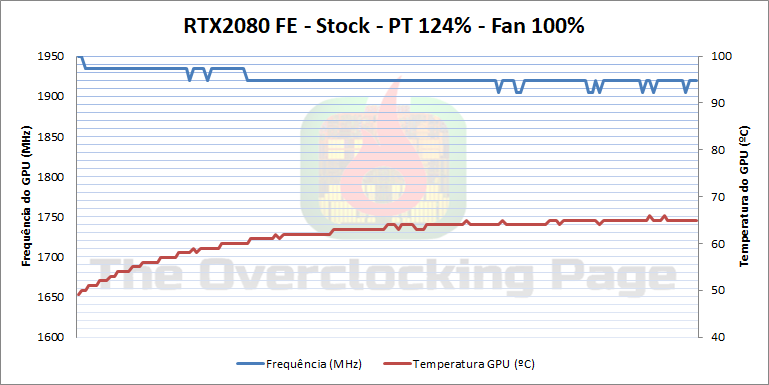

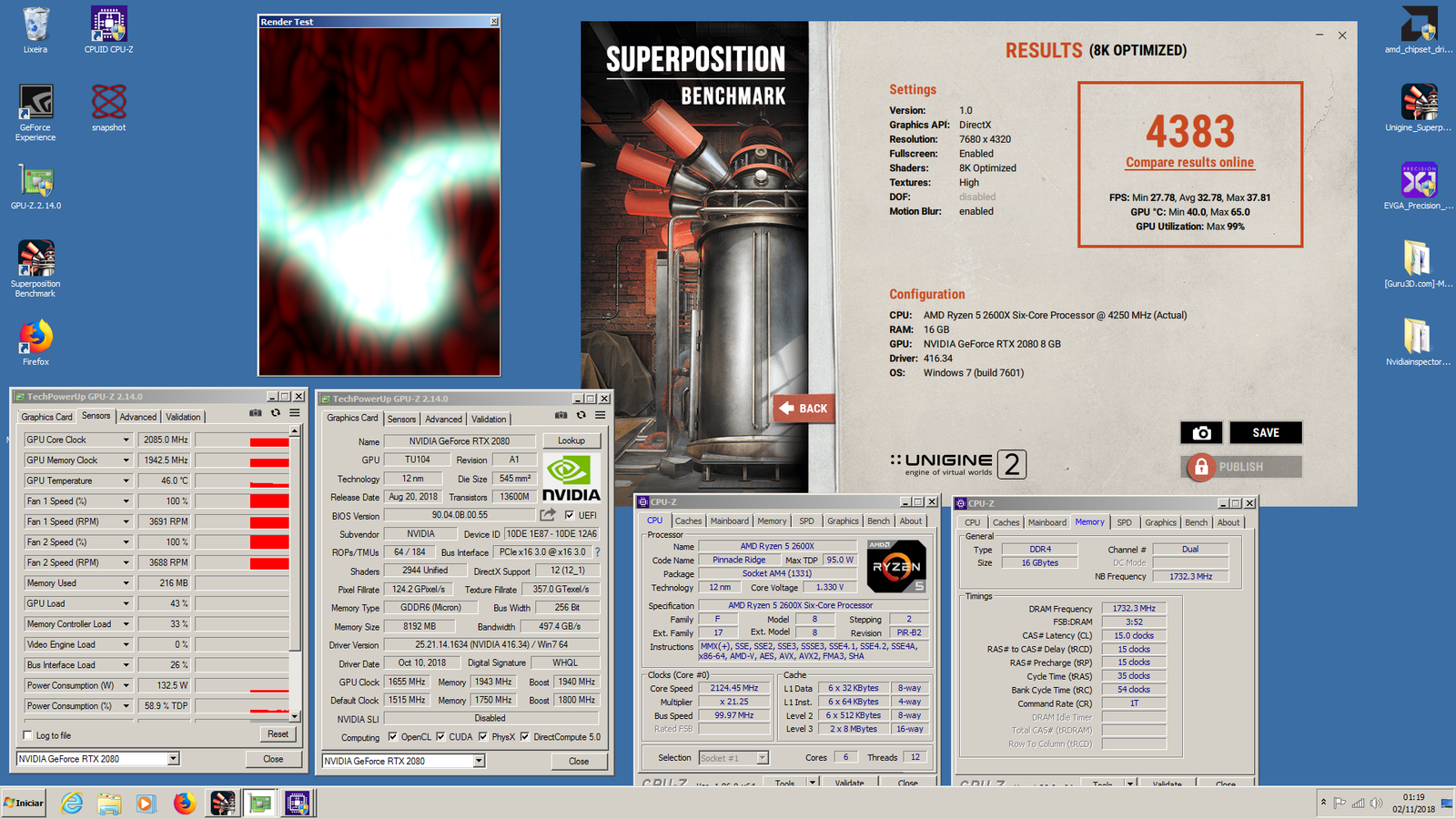

Primeiramente, vamos ver como o sistema de refrigeração da nVidia se sai. Considero esse teste bastante relevante pois assim como disse anteriormente, nas GPUs Turing, quanto menor a temperatura do GPU, maiores as chances do GPU Boost 4.0 manter a placa funcionando no ponto máximo da curva F/V. Para fazer esses testes, usei o Unigine Superposition no preset “8K Optimized”, que é um benchmark suficientemente longo (cerca de 3 minutos de duração) e que simula bem uma carga de “uso real” do GPU, em outras palavras, não é um “power virus” como o Furmark que estressa a VGA a níveis irreais e normalmente faz a placa entrar em throttling por comando do driver.

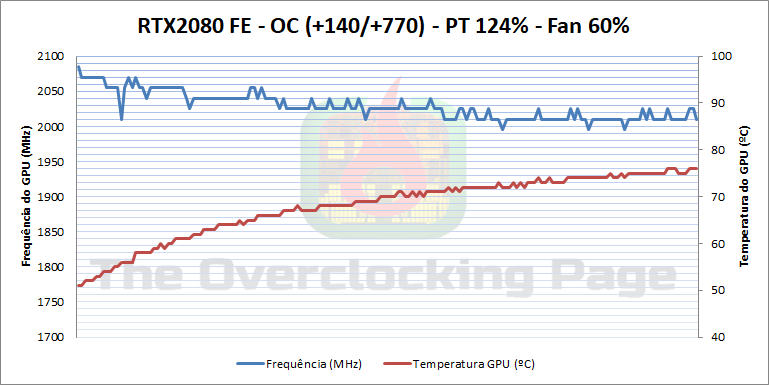

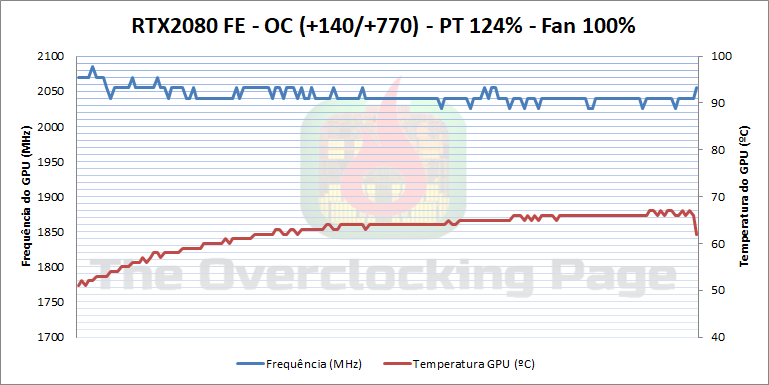

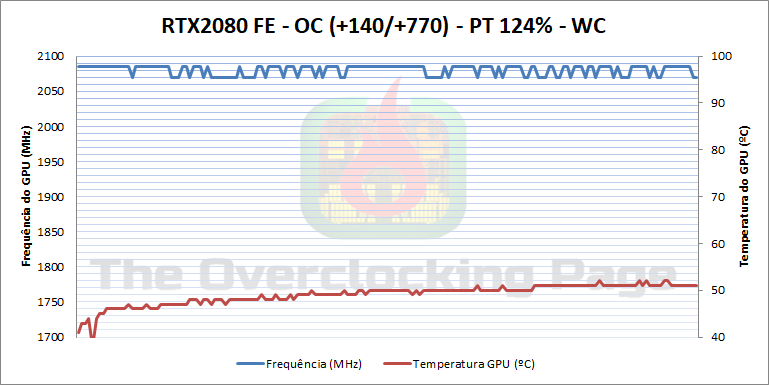

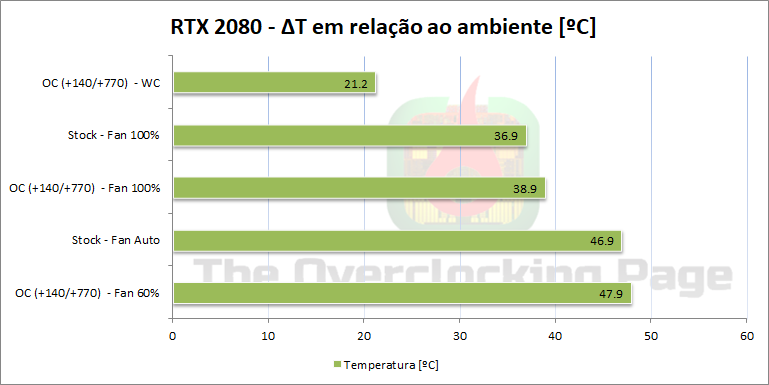

No gráfico abaixo, temos os resultados obtidos para diferentes configurações de clock e rotação do fan, sendo que no dia desses testes, a temperatura ambiente foi de 28.1ºC e como é de praxe por essas bandas, adotei nos gráficos o delta T (?T), que trata-se da diferença entre a temperatura do GPU (no caso) e a ambiente, retirando assim esse ultimo fator da jogada.

O teste em stock com fan @ 100% foi conduzido com o PT @ 124% (máximo possível para essa placa sem mods), os testes com OC também foram conduzidos com o PT @ 124%, a ideia do teste com fan @ 60% foi mostrar o melhor resultado possível de se obter mantendo um nível de ruído aceitável para uso diário. Também inclui nesse gráfico o resultado obtido pelo WC Custom apenas com o intuito de deixa-lo como referência para a posteridade, afinal de contas, a comparação entre as soluções utilizadas não é lá muito razoável.

Algo que também é digno de nota é que com o PT @ 124%, a RTX2080 FE nunca bateu no PerfCap por conta desse parâmetro, ou seja, a utilidade de mods para o Power Limit nessa placa se resumem apenas a situações de overclock extremo com o GPU operando acima dos 1.06V, o que é uma excelente notícia para ~99% das pessoas. 🙂

E por fim, é importante destacar que todos esses testes, com exceção dos benchmarks competitivos, foram realizados usando o Ryzen 5 2600X ao invés do 2700X e foi feito assim pois quando este ultimo chegou, já havia colhido todos esses dados.

E os resultados obtidos foram bastante positivos! O pior caso foi com o Fan 60% e OC onde apresentou-se um ?T de 47.9ºC, o que significa que a temperatura do GPU só deve chegar nos 80ºC em load para um temperatura ambiente na casa dos 32ºC+, o que é bastante razoável se considerarmos que dessa forma o ruído de operação ainda se mantém em níveis bastante civilizados e que também a placa está com overclock.

Tenham em mente que esses testes aqui são todos conduzidos em bancada e que a temperatura “ambiente” dentro de um gabinete tende a ser maior que a temperatura ambiente de fato, o que é um detalhe importante caso alguém venha a tentar reproduzir os testes aqui realizados. 😉

Como é possível ver nas legendas no eixo do gráfico acima, fiz o overclock via offset e logo na galeria abaixo, temos o comportamento da placa em termos dos clocks e temperaturas (valores absolutos aqui, não são os deltas) ao longo do benchmark.

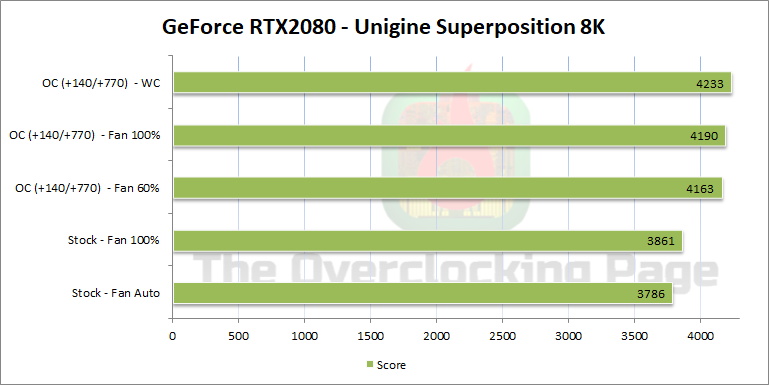

Por esses gráficos fica bastante evidente o funcionamento do GPU Boost e a influência dos fatores externos no clock do GPU, conforme expliquei anteriormente. Notem que ao eliminar duas causas para a placa estar batendo no PerfCap (Pwr e Thrm), houve uma estabilidade muito maior no clock da placa em stock. Também cabe observar que ter montado o water cooler na placa produziu efeito semelhante, mantendo o clock em um patamar mais elevado durante o tempo todo com OC e ainda que não tenha tido ganhos de frequência, esse efeito por si só já deve trazer um impacto positivo na performance, o que pode ser visto no gráfico abaixo, que trata do resultado do benchmark em cada uma dessas condições de teste.

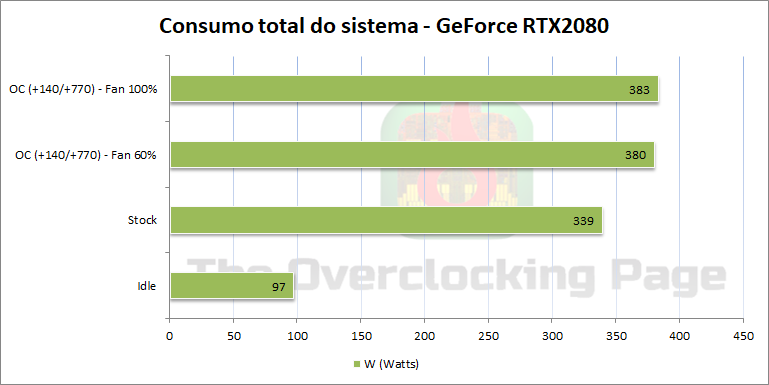

Em relação ao consumo do sistema, a RTX2080 FE se mostrou bastante eficiente e nunca excedeu a marca dos 400W mesmo com overclock. Tenham em mente que os valores aqui apresentados são do sistema todo e são bastante aproximados, afinal de contas, meu wattímetro não possui função datalogger, o que permitiria uma maior precisão nas medições, de qualquer forma, é possível ter pelo menos uma noção do consumo do sistema.

Para esse teste de consumo, o Ryzen 5 2600X estava operando @ 4250 1.35V, a RAM estava @ 3533 14-14-14-30 1T utilizando o perfil do The Stilt da Crosshair VII Hero. O driver estava com as configurações padrão, exceto o gerenciamento de energia que estava em “Desempenho Máximo”.

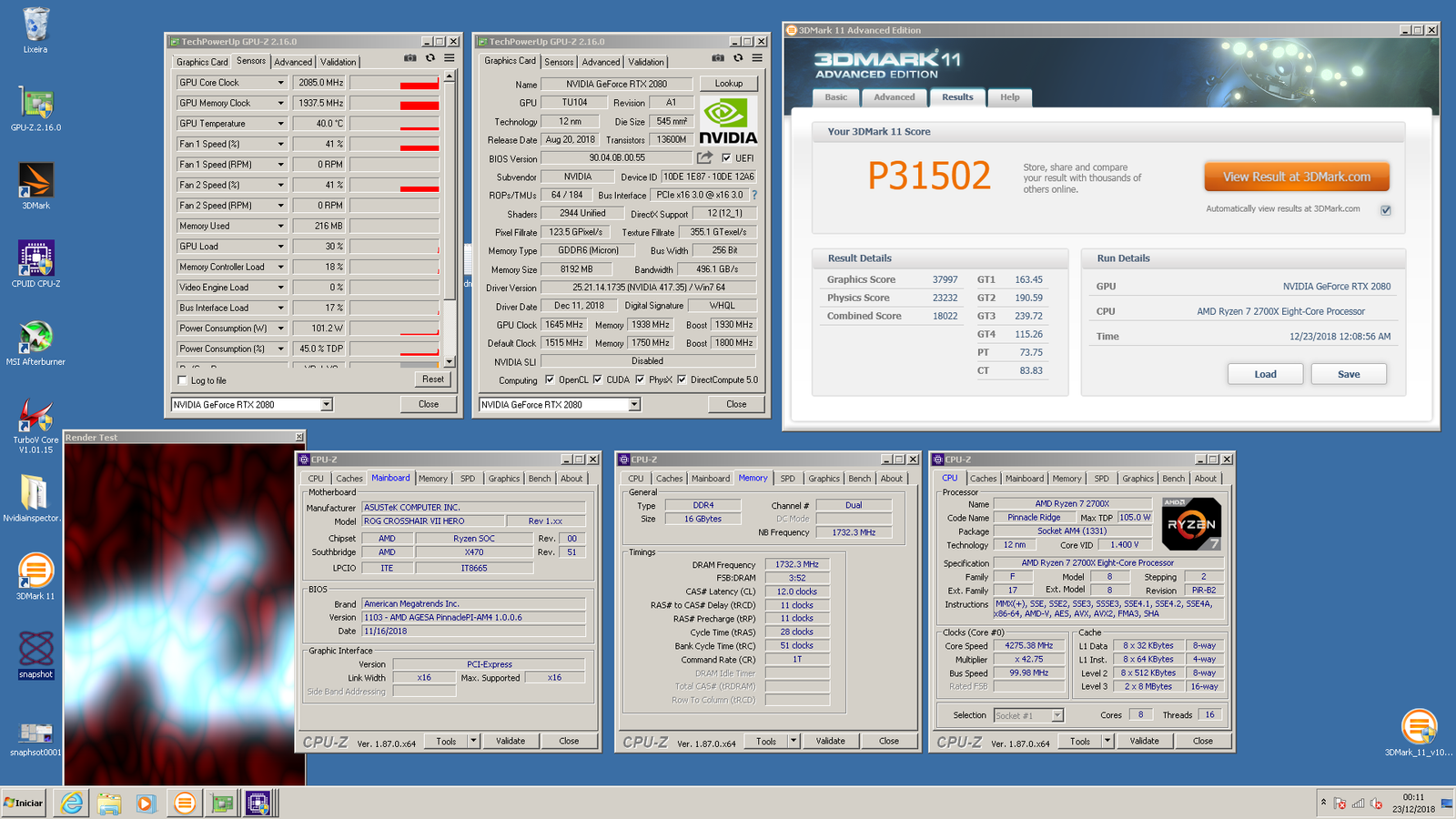

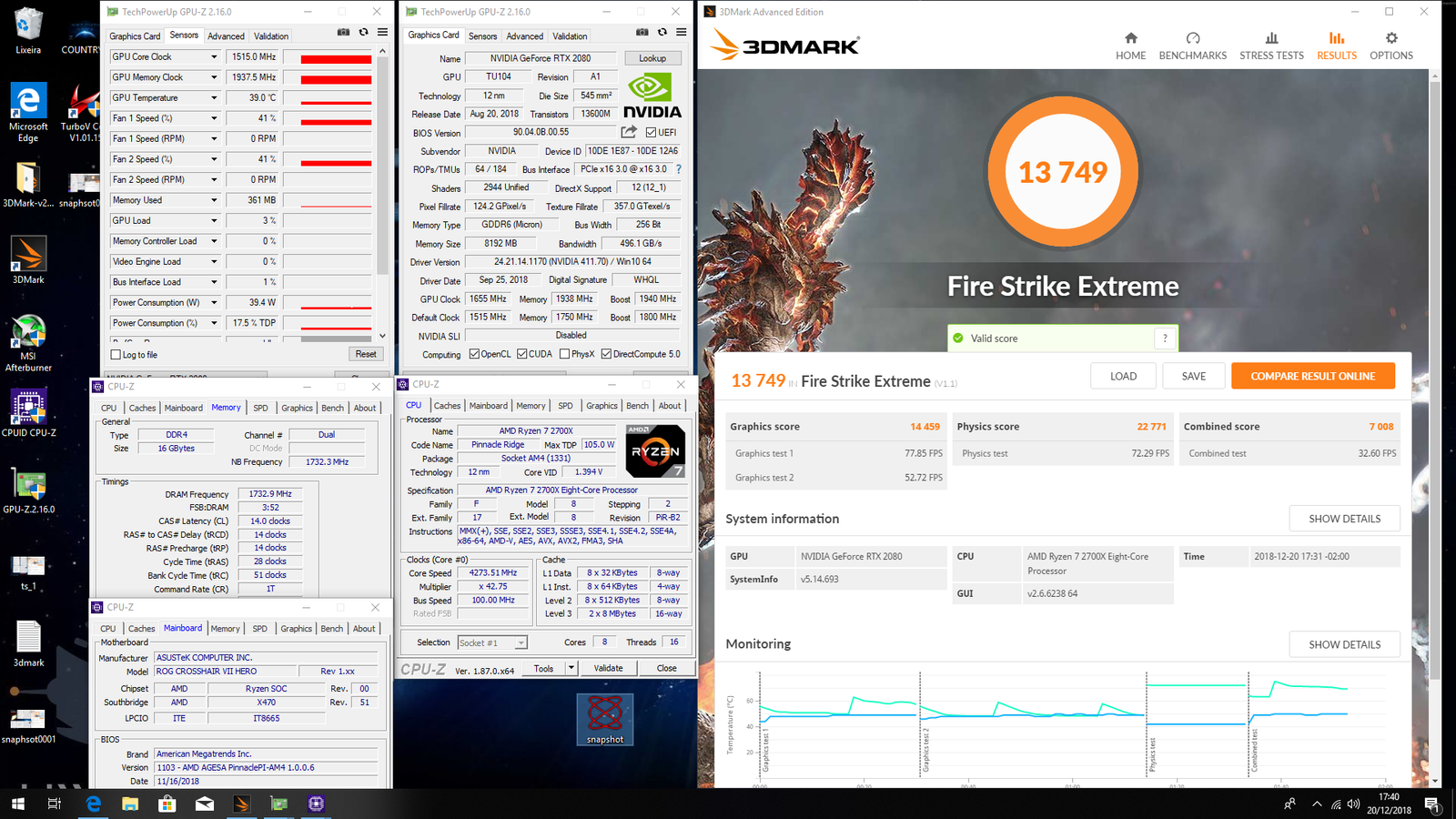

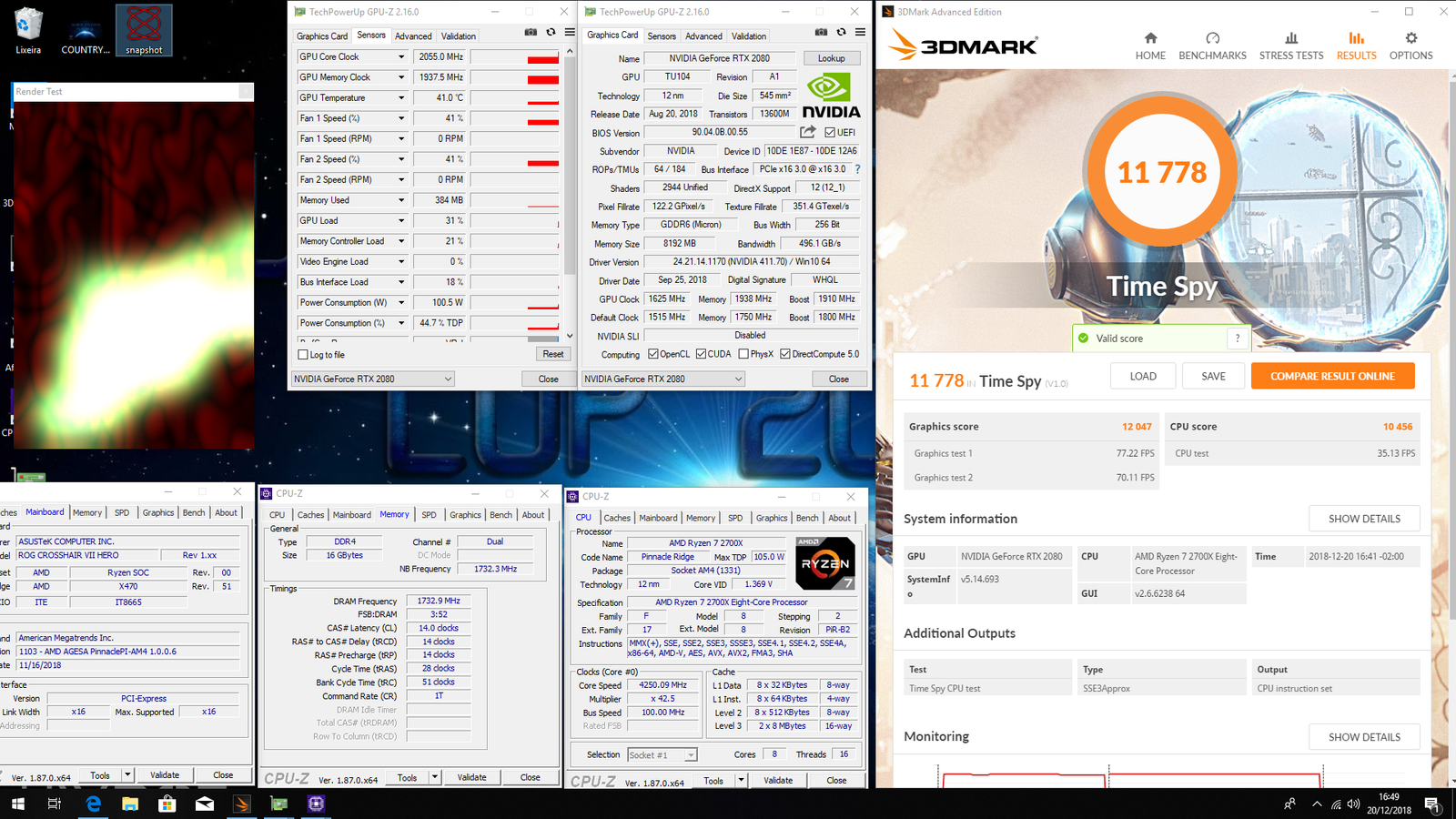

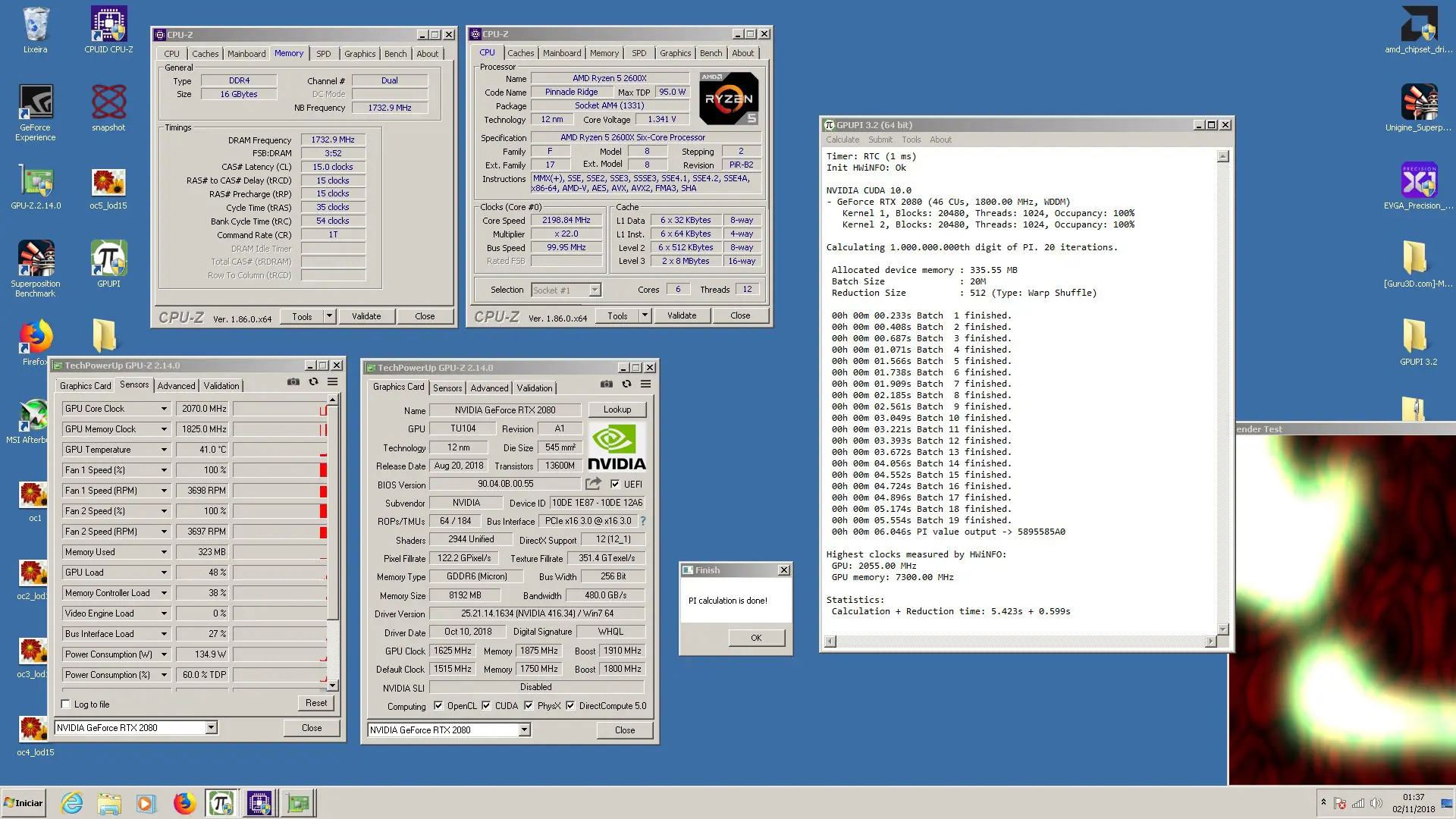

Sobre os obtidos nos benchmarks competitivos utilizando refrigeração a água, foi possível completar 3DMark11/FSE/FSU e Superposition 8K com clocks variando entre 2085 e 2070MHz, o que é bastante razoável porém aquém do que um GPU premiado pode fazer (2100+). No que diz respeito aos benchmarks DX12 que fazem uso extensivo de compute shaders e os que usam CUDA/OpenCL como o GPUPI, foi possível completar os mesmos com clocks na casa dos 2055MHz, o que pelo menos no caso do GPUPI foi uma surpresa pois geralmente é possível completar esse benchmark com clocks bem maiores que aqueles usados para 3D.

De todo modo, os resultados obtidos foram satisfatórios com a RTX2080 FE, com a placa sendo definitivamente superior a 1080Ti nos benchmarks DX12 ou de Compute e ficando pouco abaixo dessa nos Fire Strike.

Conclusão:

A nVidia RTX2080 FE como item de hardware se mostrou praticamente impecável devido ao excelente trabalho realizado naquilo que diz respeito ao design, acabamento, qualidade de construção e os componentes utilizados, o que elevou e muito o padrão para uma placa de referência, como é o caso. Nesse departamento, a única ressalva que fica é por conta do uso de diversos tipos de parafusos diferentes, o que é um fator de complicação na hora de fazer a manutenção da placa e que poderia ter sido evitado.

Do ponto de vista tecnológico, estamos diante de uma placa que permite o uso de Ray Tracing em tempo real, trás novos recursos que permitem melhorar a IQ/desempenho ao mesmo tempo (DLSS) e importantes incrementos na arquitetura, ou seja, em termos de inovação, a RTX2080 e a série RTX como um todo também são impecáveis!

Apesar de todos esses pontos positivos, infelizmente existem alguns “senões”, por exemplo, se você tem interesse em comprar uma RTX2080 desse modelo em especifico, a única opção disponível é comprar a mesma pela nVidia Store, o que significa que você vai ter que lidar com frete internacional, possibilidade de problemas alfandegários e demais aspectos característicos desse tipo de compra. Outro ponto sensível é o preço, o MSRP para a RTX2080 é de $699 e no caso dessa Founders Edition, que é tratada (e de fato o é) como um modelo premium é de $799, ou seja, a XX80 dessa geração acabou sendo reposicionada no lugar da XX80 Ti da geração anterior e entrega desempenho marginalmente superior a essa ultima, exceto nos poucos jogos que já oferecem suporte a DLSS e aplicações compute heavy, onde ai RTX 2080 apresenta desempenho definitivamente superior a GTX 1080Ti. Por fim, o último ponto é que até o momento temos apenas um jogo de peso com suporte a RT, o que segundo a nVidia deve mudar em um futuro bem próximo mas que no momento é algo um tanto “pesado” para o consumidor que pretende desembolsar uma quantia considerável pela placa para ver “ao vivo” o que o tal Ray Tracing pode fazer por ele.

E é isso! Comentários, críticas e sugestões são bem-vindas! Até a próxima! 🙂

Fala Giancarlo, beleza. Eu abri uma GTX 690, e ela usa nos mosfets uma “massa termica”, bem comum nas placas, pois neste review, vi que é usada algo similar nos indutores da RTX 2080. Mas a minha dúvida o que é realmente esse material, como posso encontrar um de boa qualidade para substitui-lo, e posso substituir por um termal pad de silicone de boa qualidade? Grande abraço.

Ola Thiago,

Pode usar thermalpad sim, só se certifique de pegar um da espessura correta e que não seja condutivo.